A Deloitte kutatása szerint a szervezeteknek csak 23 százaléka érzi magát teljesen felkészültnek a mesterséges intelligenciával kapcsolatos kockázatok kezelésére, ami jelentős hiányosságokat hagy a felügyelet és a biztonság terén.

Mi az AI Governance?

A mesterséges intelligencia irányítása a mesterséges intelligencia fejlesztését, használatát és szabályozását irányító politikák, keretek és felügyeleti rendszerek rendszere. Ez biztosítja, hogy a mesterséges intelligencia átláthatósággal, elszámoltathatósággal és biztonsággal működjön a szervezetekben, iparágakban és kormányokban.

A mesterséges intelligencia rendszerek védelme, hogy azok biztonságosan, etikusan és a szabályozásoknak megfelelően működhessenek, kiemelt prioritássá vált. Megfelelő irányítás nélkül a mesterséges intelligencia rendszerek előítéleteket hozhatnak létre, megsérthetik a szabályozási követelményeket, vagy biztonsági kockázatokká válhatnak.

Például egy korábbi felvételi adatokon kiképzett mesterséges intelligencia-toborzási eszköz véletlenül előnyben részesíthet bizonyos demográfiai jellemzőket másokkal szemben, ami megerősítheti a diszkriminatív mintákat. Az olyan ágazatokban, mint az egészségügy vagy a pénzügy, a regionális adatvédelmi törvények betartása nélkül alkalmazott mesterséges intelligencia szabályozási jogsértésekhez és jelentős bírságokhoz vezethet.

Ezen túlmenően a nyilvános szolgáltatásokba integrált, megfelelő fenyegetésmegelőzési ellenőrzések nélküli mesterséges intelligenciamodelleket rosszindulatú kihasználási kísérletek révén ki lehet használni, ami kibertámadásoknak és működési zavaroknak teszi ki a szervezeteket.

A mesterséges intelligencia irányításának legfontosabb alapelvei

A jól meghatározott AI-irányítási stratégia olyan alapvető elveket tartalmaz, amelyek segítenek a szervezeteknek abban, hogy megőrizzék az ellenőrzést az AI-vezérelt döntéshozatal felett. A Ponemon Intézet felmérése szerint a válaszadók 54 százaléka alkalmazza az AI-t, míg a biztonsági csapatok 47 százaléka aggodalmakról számolt be az AI által generált kód által bevezetett sebezhetőségek miatt.

A következő alapelvek központi szerepet játszanak a hatékony AI-irányításban, és segítenek csökkenteni mind az operatív, mind a biztonsági kockázatokat:

Biztonsági protokollok védik a mesterséges intelligenciamodelleket az ellenséges támadásoktól, az illetéktelen módosításoktól és az új kiberfenyegetésektől.

Az elszámoltathatóság biztosítja, hogy a mesterséges intelligencia rendszerek kijelölt felügyelettel rendelkezzenek, megelőzve a szabályozatlan döntéshozatalt és megerősítve az emberi ellenőrzést.

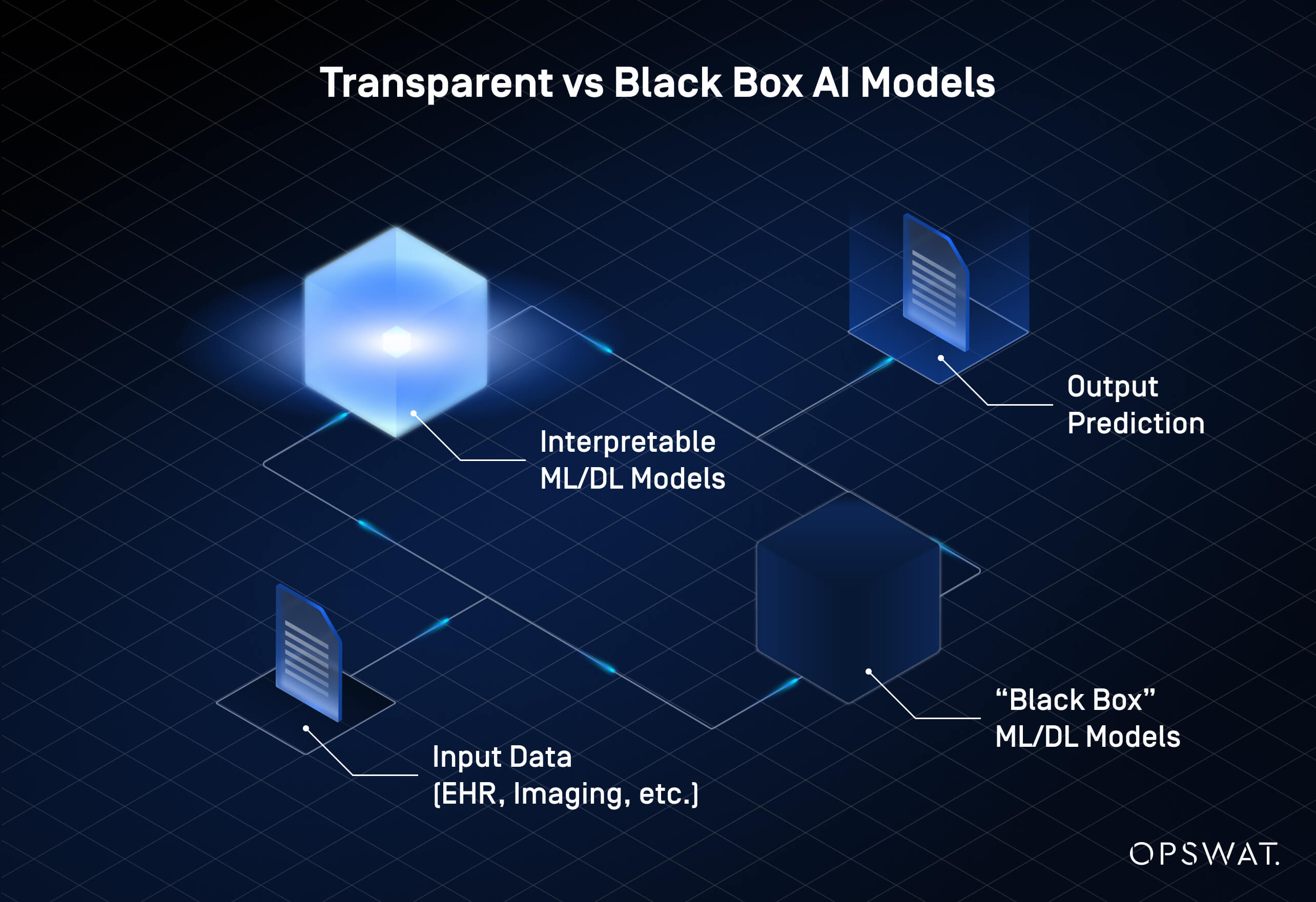

Az átláthatóság megköveteli, hogy a mesterséges intelligencia modellek világos betekintést nyújtsanak a döntéshozatali folyamatokba, csökkentve ezzel az értelmezhetőséget nélkülöző "fekete doboz" modellek kockázatát.

Ezen elvek irányítási keretrendszerekbe való beágyazásával a szervezetek csökkenthetik a kockázatokat, miközben fenntartják a mesterséges intelligencia technológiák hatékonyságát és skálázhatóságát.

Az AI kockázatkezelés növekvő igénye

A mesterséges intelligencia gyors elterjedése új kihívások elé állította a kockázatkezelést és a megfelelőséget. Alkalmazkodó stratégiák nélkül a szervezetek azt kockáztatják, hogy lemaradnak az újonnan megjelenő fenyegetések és a szabályozási nyomások kezelésében.

A mesterséges intelligencia kockázatkezelés a következőkre összpontosít:

- Az irányítási stratégiák összehangolása a fejlődő szabályozásokkal és az iparág-specifikus AI-felügyeleti megbízásokkal biztosítja, hogy a szervezetek megfeleljenek a jogi követelményeknek.

- Folyamatos elfogultság-felderítésre és méltányossági ellenőrzésekre van szükség a mesterséges intelligencia döntéshozatalában előforduló diszkriminatív minták megelőzése érdekében.

- A mesterséges intelligenciával támogatott adathalász támadások , a deepfake csalások és a modellmanipuláció egyre nagyobb aggodalomra adnak okot, és proaktív biztonsági intézkedéseket igényelnek.

Ahhoz, hogy a szervezetek megelőzzék ezeket a kockázatokat, a mesterséges intelligencia irányítását be kell építeniük a szélesebb körű kockázatkezelési keretrendszerekbe, biztosítva, hogy a megfelelés, a biztonság és az etikai megfontolások továbbra is szerves részét képezzék a mesterséges intelligencia fejlesztésének és bevezetésének.

AI irányítási keretek

A strukturált AI-irányítási keretrendszer segít a szervezeteknek a megfelelési követelményekkel, a kockázatok kezelésével és a biztonsági intézkedések AI-rendszerekbe történő integrálásával. Az egyértelmű biztonsági irányítási modell beépítése az AI kockázatkezelési keretrendszerekbe csökkenti az AI-kezdeményezések széttöredezettségét és erősíti a megfelelőségi lefedettséget.

Keretrendszer fejlesztése

A mesterséges intelligencia irányítási keretrendszerének kialakítása stratégiai megközelítést igényel, amely összhangban van a szervezeti irányelvekkel és a szabályozási előírásokkal. Az alábbi elemek a hatékony keretrendszer-fejlesztési folyamat alapvető összetevői:

Kockázatértékelés

A mesterséges intelligenciamodellek sebezhető pontjainak azonosítása, beleértve az elfogultságot, az adatvédelmi aggályokat és a biztonsági fenyegetéseket.

Szabályozási integráció

Biztosítani kell, hogy a mesterséges intelligencia irányítása összhangban legyen az iparág-specifikus követelményekkel és a globális szabványokkal.

Funkcióközi együttműködés

Hozzon létre egy olyan irányítási keretrendszert, amely az etikai aggályokat és a működési igényeket egyaránt figyelembe veszi.

Integráció a meglévő szervezeti irányelvekkel

A mesterséges intelligencia irányításának nem szabad elszigetelten működnie, hanem össze kell hangolódnia a kiberbiztonságra, etikára és kockázatkezelésre vonatkozó szélesebb körű vállalati politikákkal. A mesterséges intelligenciára vonatkozó irányelvek beépítése a vállalati kockázatkezelésbe biztosítja, hogy a mesterséges intelligencia modellek megfeleljenek a biztonsági protokolloknak és az etikai irányelveknek.

A mesterséges intelligencia ellenőrzési mechanizmusok segíthetnek a kormányzási hibák korai felismerésében, míg a megfelelőség nyomon követése lehetővé teszi a szervezetek számára, hogy a fejlődő szabályozások előtt járjanak. Az AI-szolgáltatókkal és biztonsági szolgáltatókkal kötött külső partnerségek szintén javíthatják az irányítási stratégiákat, csökkentve a harmadik féltől származó AI-megoldásokkal kapcsolatos kockázatokat.

Végrehajtási stratégiák

A sikeres AI-irányításhoz strukturált végrehajtási megközelítésre van szükség, amely mind a technológiai, mind a szakpolitikai alapú stratégiákat kihasználja. Sok szervezet fordul a mesterséges intelligencia alapú megfelelőségi eszközök felé, hogy automatizálják az irányítási folyamatokat és valós időben észleljék a szabályozási jogsértéseket. A legfontosabb végrehajtási intézkedések közé tartoznak:

- A technológiai alapú megfelelőségi megoldások a mesterséges intelligenciát használják a szabályzatok betartásának nyomon követésére, a kockázati tényezők monitorozására és az ellenőrzési eljárások automatizálására.

- Változáskezelési stratégiák biztosítják, hogy a mesterséges intelligencia irányítási irányelveket a szervezet egészében elfogadják.

- Az incidensreakció-tervezés az AI-specifikus biztonsági kockázatokkal foglalkozik, biztosítva, hogy a szervezetek proaktív intézkedésekkel rendelkezzenek az irányítási hibák, kibertámadások és etikai jogsértések kezelésére.

Az irányítási keretrendszerek meglévő irányelvekbe való beágyazásával és strukturált végrehajtási stratégiák elfogadásával a szervezetek biztosíthatják, hogy a mesterséges intelligencia rendszerek biztonságosak, etikusak és megfelelőek maradjanak.

Etikai iránymutatások és elszámoltathatóság

Mivel a mesterséges intelligencia rendszerek befolyásolják a nagy tétekkel járó döntéseket, a szervezeteknek etikai iránymutatásokat és elszámoltathatósági struktúrákat kell létrehozniuk a felelős használat biztosítása érdekében. Irányítási biztosítékok nélkül a mesterséges intelligencia elfogultságot hozhat létre, veszélyeztetheti a biztonságot, vagy a szabályozási korlátokon kívül működhet.

Etikai iránymutatások megállapítása

Az etikus AI-irányítás a méltányosságra, az átláthatóságra és a biztonságra összpontosít. Az alábbi gyakorlatok elengedhetetlenek az AI-fejlesztés és -beépítés etikai alapjainak megteremtéséhez:

- Az etikus mesterséges intelligenciára vonatkozó elvek és szabványok segítenek biztosítani, hogy a mesterséges intelligencia elfogadható határokon belül működjön, elkerülve a nem szándékolt következményeket.

- Etikai kódex kidolgozása formalizálja a felelős mesterséges intelligencia-használatot, egyértelmű iránymutatásokat határoz meg az átláthatóság, az adatvédelem és az elszámoltathatóság tekintetében.

Elszámoltathatósági struktúrák létrehozása

Annak érdekében, hogy a mesterséges intelligencia irányítása végrehajtható legyen, a szervezeteknek olyan mechanizmusokra van szükségük, amelyek nyomon követik a megfelelőséget és lehetővé teszik a korrekciós intézkedéseket. A közös elszámoltathatósági intézkedések közé tartoznak:

- A mesterséges intelligencia auditok értékelik a modell teljesítményét, a megfelelőséget és a biztonsági réseket.

- Az incidensreakció-tervezés felkészíti a szervezeteket a mesterséges intelligenciával kapcsolatos hibák, biztonsági rések és irányítási hiányosságok kezelésére.

Az etikai irányelvek és az elszámoltathatósági intézkedések irányítási keretrendszerekbe való beágyazásával a szervezetek kezelni tudják a mesterséges intelligenciával kapcsolatos kockázatokat, miközben fenntartják a bizalmat és a megfelelőséget.

Szabályozási keretek

A szabályozási kereteknek való megfelelés kritikus fontosságú, mégis sok szervezet küzd azzal, hogy lépést tartson a fejlődő irányelvekkel. A Deloitte szerint a szabályozási bizonytalanság az egyik legfőbb akadálya a mesterséges intelligencia bevezetésének, és sok vállalkozás vezetési struktúrákat vezet be a megfelelési kockázatok kezelésére.

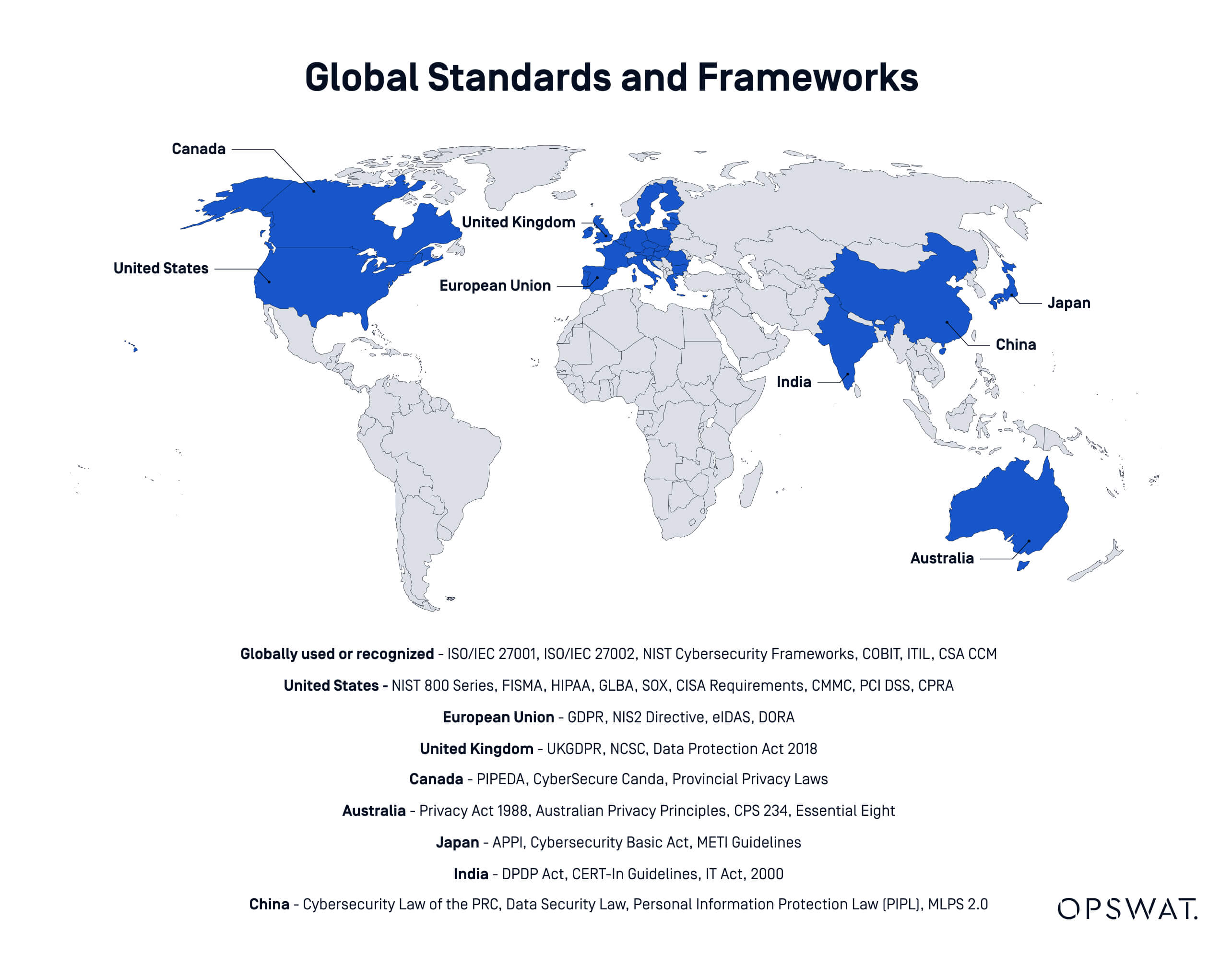

A globális szabályozások áttekintése

A mesterséges intelligencia irányítását régióspecifikus jogszabályok alakítják, amelyek mindegyike eltérő megfelelési követelményekkel rendelkezik. Az alábbi példák azt szemléltetik, hogy a szabályozás hogyan változik a legfontosabb joghatóságok között:

- Az uniós AI-törvény szigorú felügyeletet ír elő, átláthatóságot, kockázatértékelést és emberi felügyeletet követel meg a magas kockázatú AI-alkalmazások esetében. A 6. cikk szerint az AI-rendszerek akkor minősülnek magas kockázatúnak, ha kritikus infrastrukturális ágazatokban működnek. Az EU-ban működő szervezeteknek az AI-irányelveket ezen iránymutatásokhoz kell igazítaniuk.

- Az Egyesült Államok SR-11-7 szabványa meghatározza a pénzügyi intézményekben alkalmazott mesterséges intelligenciával kapcsolatos kockázatkezelési elvárásokat, a modellérvényesítésre, az irányításra és a biztonsági ellenőrzésekre összpontosítva. Hasonló ágazatspecifikus iránymutatások jelennek meg az egyes iparágakban.

- Más nemzetközi irányelvek, köztük a kanadai, szingapúri és kínai szabályozás, a mesterséges intelligencia etikus használatát, a fogyasztóvédelmet és a vállalati felelősségvállalást hangsúlyozzák. A vállalkozásoknak nyomon kell követniük a szabályozási fejleményeket azokban a régiókban, ahol a mesterséges intelligenciát alkalmazzák.

Az etikai irányelvek és az elszámoltathatósági intézkedések irányítási keretrendszerekbe való beágyazásával a szervezetek kezelni tudják a mesterséges intelligenciával kapcsolatos kockázatokat, miközben fenntartják a bizalmat és a megfelelőséget.

Megfelelési stratégiák

A mesterséges intelligenciára vonatkozó szabályozásoknak való megfelelés biztosítása proaktív megközelítést igényel. Az alábbi stratégiák segítenek a szervezeteknek abban, hogy az irányítási kereteket összehangolják a változó jogi követelményekkel, különösen a magas kockázatú AI-rendszerekkel való munka során:

- A megfelelőségi csapat kialakítása lehetővé teszi a szervezetek számára a szabályozási kockázatok kezelését, az AI-ellenőrzések felügyeletét és a szükséges irányítási intézkedések végrehajtását.

- A szabályozási kihívások kezelése a szakpolitikai változások folyamatos nyomon követését jelenti, miközben az irányítási struktúrákat a gyakran egymást átfedő szabályozások összetett környezetében kell kiigazítani.

- A szabályozási auditok és a jelentéstétel segít a szervezeteknek a megfelelőség bizonyításában és a jogi kockázatok megelőzésében a proaktív nyomon követés révén.

A megfelelőségi stratégiáknak a mesterséges intelligencia irányítási keretrendszerekbe való beágyazásával a szervezetek mérsékelhetik a szabályozási kockázatokat, miközben biztosítják, hogy a mesterséges intelligencia etikus és biztonságos maradjon.

Átláthatóság és magyarázhatóság

A szervezetekre egyre nagyobb nyomás nehezedik, hogy a mesterséges intelligencia által vezérelt döntéseket megmagyarázhatóvá tegyék, különösen az olyan magas kockázatú alkalmazásokban, mint a pénzügy, az egészségügy és a kiberbiztonság. Ennek ellenére sok AI-modell továbbra is összetett, ami korlátozza a működésük átláthatóságát.

Átlátható mesterséges intelligencia rendszerek tervezése

A mesterséges intelligencia átláthatósága magában foglalja a döntéshozatali folyamatok érthetővé tételét az érdekelt felek, a szabályozók és a végfelhasználók számára. A következő megközelítések támogatják a mesterséges intelligencia megmagyarázhatóságát, és segítenek csökkenteni az úgynevezett fekete dobozos mesterséges intelligenciamodellekkel kapcsolatos kockázatokat, amelyek belső működése nem könnyen érthető:

- A hatékony kommunikációs stratégiák segítenek a szervezeteknek abban, hogy a mesterséges intelligencia alapú döntéshozatalt világos, értelmezhető eredményekké alakítsák. A dokumentáció, a modellösszefoglalók és a hatásvizsgálatok biztosítása javíthatja az átláthatóságot.

- Az átláthatóságot szolgáló eszközök és technológiák biztosítják a megmagyarázható mesterséges intelligenciát azáltal, hogy betekintést nyújtanak abba, hogy a mesterséges intelligencia modellek hogyan dolgozzák fel az adatokat és hogyan generálnak eredményeket. Az AI-ellenőrzési eszközök, az értelmezhetőségi keretrendszerek és a megmagyarázható AI (XAI) technikák segítenek a fekete dobozos döntéshozatal körüli aggodalmak enyhítésében.

Az átláthatóság előtérbe helyezésével a szervezetek javíthatják a szabályozási összehangolást, csökkenthetik az elfogultsággal kapcsolatos kockázatokat, és bizalmat építhetnek az AI-alkalmazásokba.

Monitoring és folyamatos fejlesztés

A mesterséges intelligencia irányítása folyamatos folyamat, amely folyamatos nyomon követést, kockázatértékelést és finomítást igényel a biztonság és a megfelelőség biztosítása érdekében. Mivel az AI-vezérelt rendszerek egyre nagyobb mennyiségű érzékeny adatot kezelnek, a szervezeteknek biztonságos munkafolyamatokat kell kialakítaniuk a jogosulatlan hozzáférés és a szabályzatok megsértésének megelőzése érdekében.

A felügyelt fájlátviteli megoldások kritikus szerepet játszanak a mesterséges intelligenciára vonatkozó irányelvek érvényesítésében, az ellenőrizhetőség fenntartásában és a megfelelési kockázatok csökkentésében a mesterséges intelligencia által vezérelt adatcserék során.

Teljesítménymérők és visszacsatolási hurok

Az AI-rendszerek teljesítményének nyomon követése elengedhetetlen a megbízhatóság, a biztonság és a megfelelőség biztosításához. Az alábbi gyakorlatok hozzájárulnak a megbízható felügyelethez és az adaptív irányításhoz:

- Secure megakadályozzák a jogosulatlan hozzáférést és biztosítják, hogy az AI-vezérelt adatcsere szigorú biztonsági irányelveket kövessen. OPSWAT MetaDefender Managed File Transfer MFT)™Managed File Transfer lehetővé teszi a szervezetek számára a titkosítás, a hozzáférés-ellenőrzés és az automatizált megfelelőség-ellenőrzés érvényesítését, hogy csökkentsék az adatok kiszivárgásának kockázatát.

- Adaptive irányítási mechanizmusok lehetővé teszik a mesterséges intelligencia modellek számára, hogy a folyamatos visszajelzések alapján finomítsák a döntéshozatalt, miközben szigorú biztonsági és megfelelőségi intézkedéseket tartanak fenn. Az AI-alapú biztonsági megoldások, például a Managed File Transfer platformok segítenek az érzékeny adatok valós idejű osztályozásában, biztosítva a változó szabályozási követelmények betartását.

Kockázati keretek kiépítése a folyamatos javítás érdekében

Az AI-alapú munkafolyamatokat folyamatosan értékelni kell a sebezhetőség szempontjából, különösen a kiberfenyegetések fejlődésével. A Világgazdasági Fórum szerint a megkérdezett szervezetek 72 százaléka számolt be a kiberkockázatok növekedéséről az elmúlt évben, amit az adathalászat, a social engineering, a személyazonosság-lopás és a kiberalapú csalás növekedése okozott. A következő stratégiák támogatják a hosszú távú ellenálló képességet:

- Az AI-vezérelt biztonsági intézkedések integrálják a fejlett fenyegetésfelismerést, az adatvesztés megelőzésétés a megfelelőségi ellenőrzéseket, így védve az AI-adatok cseréjét.Managed File Transfer MetaDefender Managed File Transfer MFT)™ biztosítja, hogy a szervezetek biztonságosan továbbíthassák az AI-érzékeny adatokat anélkül, hogy növelnék a szabályozási kockázatot.

- Az automatizált megfelelés-érvényesítés egyszerűsíti a jogszabályi előírások betartását azáltal, hogy előre meghatározott biztonsági irányelveket alkalmaz minden mesterséges intelligenciával kapcsolatos fájlátvitelre. Az AI-alapú irányítási megoldások kihasználásával a szervezetek csökkenthetik az adatbiztonság megsértésének kockázatát, miközben fenntartják a működési hatékonyságot.

A biztonságos adatfolyamatok beépítésével az AI-irányítási stratégiákba a szervezetek javíthatják a biztonságot, fenntarthatják a megfelelőséget és biztosíthatják az AI-vezérelt döntéshozatal integritását. Az olyan megoldások, mint MetaDefender Managed File Transfer MFT), biztosítják a biztonságos és megfelelő AI-műveletek támogatásához szükséges védelmet.

MetaDefender Managed File Transfer MFT) – AI biztonsági és megfelelőségi megoldás

MetaDefender Managed File Transfer MFT) az alábbi szolgáltatásokkal játszik kulcsfontosságú szerepet az AI biztonsági irányításában:

- Szabályzatilag ellenőrzött fájlátvitel, amely automatikusan alkalmazza a biztonsági ellenőrzéseket, például a hozzáférési korlátozásokat, a titkosítási követelményeket és a megfelelőségi érvényesítést.

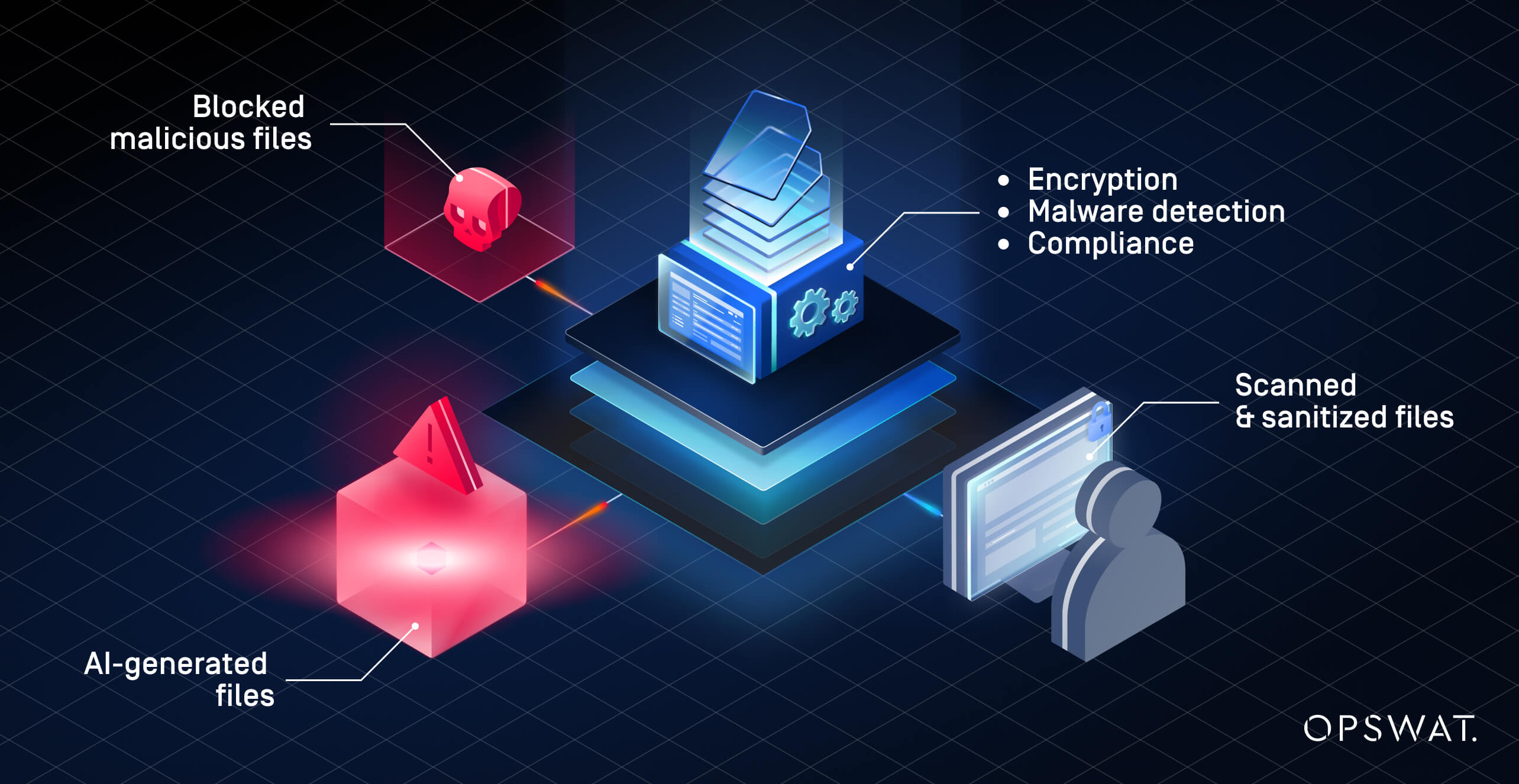

- Fejlett fenyegetésmegelőzés a többszintű felismerés révén, amely azonosítja és blokkolja a rosszindulatú szoftvereket, zsarolóprogramokat, beágyazott szkripteket és más fájlalapú fenyegetéseket, amelyeket az AI által generált támadásokban gyakran használnak.

- Megfelelőségorientált biztonsági intézkedések, amelyek támogatják a szabályozási előírásokat, beleértve a GDPR-t, a PCI DSS-t és a NIS2-t, az auditnaplózás, a szerepalapú hozzáférés-szabályozás és a testreszabható házirend-kényszerítés integrálásával.

- Secure, irányított adatfolyamatok, amelyek biztosítják, hogy a mesterséges intelligencia által vezérelt fájlátvitel titkosított (AES-256, TLS 1.3), integritás-ellenőrzött és a cserefolyamat során a manipulációtól vagy a rosszindulatú hasznos terhek bejuttatásától védett legyen.

- Multiscanning heurisztikus és gépi tanulási Multiscanning , a Deep CDR™ technológi Multiscanning , valamint mesterséges intelligencián alapuló sandboxing-technológiákkal Multiscanning integrálásával MetaDefender Managed File Transfer MFT) megvédi a mesterséges intelligencia által generált adatokat a folyamatosan változó kiberfenyegetésektől, miközben biztosítja a mesterséges intelligenciára vonatkozó szabályozási előírások betartását.

A mesterséges intelligencia által vezérelt adatfolyamatok biztosítása

Az AI-modellek nagy mennyiségű adatra támaszkodnak, amelyek gyakran több rendszer között mozognak, így a biztonságos adatátvitel elengedhetetlen. Megfelelő ellenőrzések nélkül az AI által generált és AI által feldolgozott adatok sérülékenyek lehetnek a manipulációval, a jogosulatlan hozzáféréssel vagy a megfelelőség megsértésével szemben.

MetaDefender Managed File Transfer MFT) biztosítja, hogy az AI-alapú adatfolyamatok védelme a következőképpen maradjon fenn:

- Végponttól-végpontig tartó titkosítás AES-256 és TLS 1.3 használatával, amely biztosítja az adatok biztonságát mind az adatátvitel során, mind a nyugalmi állapotban.

- Szigorú hitelesítés és hozzáférés-szabályozás Active Directory integrációval, SSO (egyszeri bejelentkezés) és MFA (többfaktoros hitelesítés) az illetéktelen adatcsere megakadályozására.

- Az adatok integritásának ellenőrzése ellenőrzőösszeg-ellenőrzéssel, amely biztosítja, hogy a mesterséges intelligencia által generált fájlokat nem manipulálják az átvitel során.

Ezen biztonsági intézkedések érvényesítésével a szervezetek biztonságosan integrálhatják a mesterséges intelligencia által vezérelt folyamatokat a meglévő infrastruktúrájukba anélkül, hogy az érzékeny adatokat kitennék a kockázatoknak.

AI-alapú fenyegetésmegelőzés

Az AI által generált tartalom új biztonsági kihívásokat jelent, többek között ellenséges AI-támadásokat, beágyazott rosszindulatú programokat és fájlalapú kihasználásokat. MetaDefender Managed File Transfer MFT) többrétegű védelemmel erősíti a biztonságot, megakadályozva az AI-alapú kibertámadásokat, mielőtt azok eljutnának a kritikus rendszerekhez.

A Metascan™ Multiscanning technológia több mint 30 rosszindulatú szoftverek elleni programot használ az ismert és nulladik napi fenyegetések felismerésére, biztosítva, hogy az AI által generált fájlok mentesek legyenek a rosszindulatú hasznos terhektől. Tudjon meg többet erről a technológiáról itt.

A Deep CDR™ technológia eltávolítja a rejtett fenyegetéseket: eltávolítja a fájlokból az aktív tartalmakat, miközben megőrzi azok használhatóságát – ez kulcsfontosságú lépés az AI által generált támadások megelőzésében. Itt olvashat bővebben a működéséről.

MetaDefender úgy észleli a rejtőzködő kártevő programokat, hogy a gyanús, mesterséges intelligenciával cserélt fájlokat elszigetelt környezetben futtatja, majd elemzi azok viselkedését, hogy felfedje azokat a fenyegetéseket, amelyeket a hagyományos biztonsági intézkedések nem képesek észlelni. Itt olvashatja el, mit mondanak az ügyfelek erről a technológiáról.

Ezek a képességek teszik MetaDefender Managed File Transfer MFT) megoldást átfogó biztonsági megoldássá azoknak a szervezeteknek, amelyek mesterséges intelligenciával vezérelt adatcserére támaszkodnak, ugyanakkor meg kell akadályozniuk a rosszindulatú szoftverek behatolását és a szabályszegéseket.

Megfelelőségvezérelt AI-irányítás

Az AI által generált adatok szigorú szabályozási felügyelet alá tartoznak, ami megköveteli a szervezetektől, hogy olyan biztonsági irányelveket vezessenek be, amelyek biztosítják a változó jogi kereteknek való megfelelést. MetaDefender Managed File Transfer MFT) segít a vállalkozásoknak ezeknek a követelményeknek való megfelelésben azáltal, hogy proaktív megfelelési ellenőrzéseket integrál minden fájlátvitelbe:

- A Proactive DLP™ átvizsgálja az AI által generált fájlokat érzékeny tartalomra, megakadályozza az adatok jogosulatlan közzétételét, és biztosítja az olyan szabályozásoknak való megfelelést, mint a GDPR, a PCI DSS és a NIS2.

- Az átfogó ellenőrzési naplók és a megfelelőségi jelentések átláthatóságot biztosítanak a mesterséges intelligenciával kapcsolatos fájlátvitelről, lehetővé téve a szervezetek számára a hozzáférés, a módosítások és a házirendek betartásának nyomon követését.

- RBAC (szerepkör-alapú hozzáférés-szabályozás), amely granuláris jogosultságokat érvényesít, biztosítva, hogy csak az arra jogosult felhasználók férhessenek hozzá a mesterséges intelligenciával kapcsolatos fájlokhoz, illetve továbbíthassák azokat az irányítási irányelveknek megfelelően.

Ezekkel a felügyeleti funkciókkal MetaDefender Managed File Transfer MFT) nemcsak az AI-adatokat védi, hanem segít a szervezeteknek a szabályozási követelményeknek való megfelelésben is, csökkentve az AI-vezérelt folyamatokkal kapcsolatos jogi és működési kockázatokat.

Erősítse az AI biztonságát MetaDefender Managed File Transfer MFT) segítségével

Az AI-vezérelt adatfolyamatok robusztus biztonsági és megfelelőségi ellenőrzéseket igényelnek. Managed File Transfer MetaDefender Managed File Transfer MFT) fejlett fenyegetésmegelőzést, szabályozási megfelelőséget és biztonságos adatcsere-megoldásokat kínál az AI-vezérelt környezetek számára. Tudjon meg többet arról, hogyanMFT OPSWAT iparágvezető fájlátviteli megoldása,MFT az AI-irányítási stratégiáját.